Kinokontrol ng TSMC ang Produksyon ng mga AI Processor

Habang pinupuri ng lahat ang Nvidia — na ang market capitalization ay bumagsak ng $1 trilyon mas maaga sa taong ito — para sa patuloy na artificial intelligence (AI) at high-performance computing (HPC) megatrends, may isa pang kumpanya na hindi lamang nakikinabang nang malaki mula sa nasabing AI at HPC megatrends, ngunit kung saan karaniwang kinokontrol ang produksyon ng mga processor ng AI.

Sampu-sampung Bilyong Dolyar

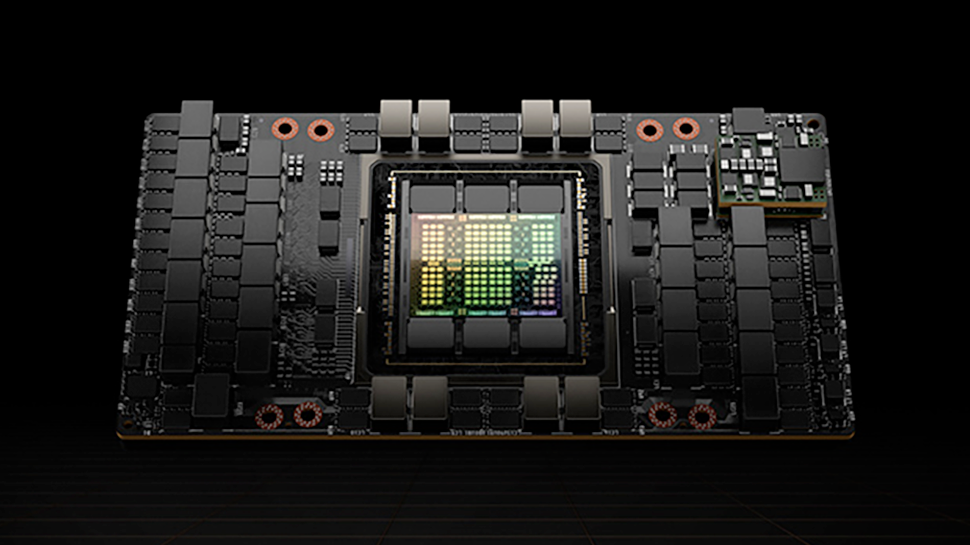

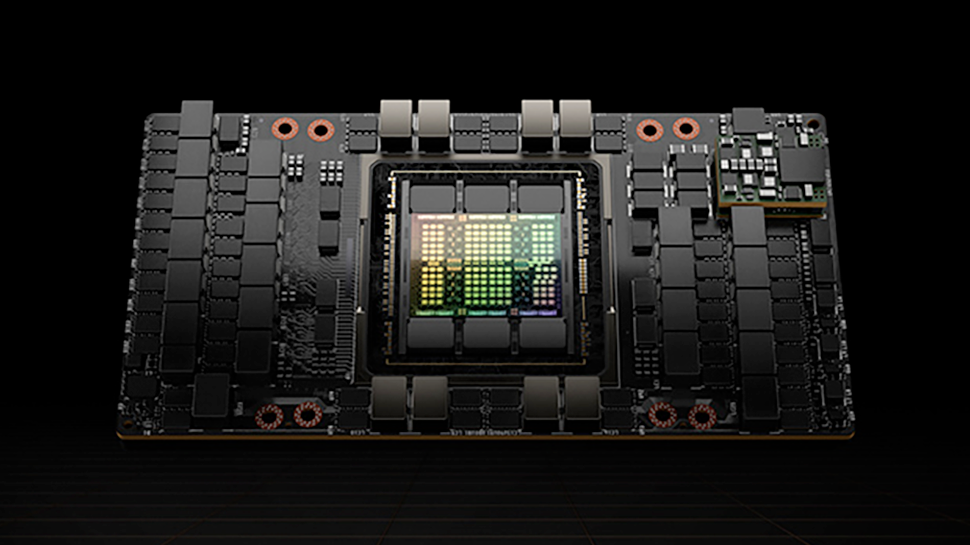

Ang kumpanyang iyon ay TSMC — na gumagawa ng ilan sa mga pinaka-kumplikadong processor para sa AI at HPC machine na binuo, kabilang ang mga mula sa Nvidia, AMD, Intel, Tenstorrent, Cerebras, at Graphcore (para lamang sa pangalan ng ilan), ayon sa isang ulat mula sa DigiTimes . Ang Nvidia’s A100 at H100 (pati na rin ang A800 at H800 derivatives nito para sa Chinese market), ang pinakasikat na compute GPU na ginagamit para sa AI at HPC workloads, ay ginawa sa TSMC, gayundin ang AMD’s EPYC CPUs at Instinct GPUs. Ang tumataas na mga bituin ng AI at HPC tulad ng Tenstorrent, at mga developer ng mga kakaibang bagay tulad ng mga wafer scale processor gaya ng Cerebras ay pinili din ang TSMC para sa kanilang mga produkto.

Bagama’t hindi ibinunyag ng TSMC kung magkano ang kinikita nito sa pagbebenta ng mga CPU, GPU, at mga dalubhasang processor o SoC para sa AI, datacenter, HPC, at mga server, ang mga produktong ito ay gumagamit ng maraming silicon — kaya malamang na kumikita ang TSMC ng sampu-sampung bilyon sa paggawa ng mga produktong iyon para sa mataas na profile na mga customer. Halimbawa, ang GH100 compute GPU ng Nvidia ay may die size na 814 mm2, samantalang ang EPYC ‘Genoa’ ng AMD ay gumagamit ng 12 Zen 4-based na CCD chiplet – bawat isa ay may sukat na humigit-kumulang 72 mm2 at sa gayon ay gumagamit ng 864 mm2 ng N5 silicon.

Bagama’t wala kaming mga hati ng kita para sa mga karibal ng TSMC na Samsung Foundry at GlobalFoundries, dahil ang mga kumpanyang ito ay nasa likod ng Taiwanese contract maker ng chips, ligtas na sabihin na ang TSMC ay nakikinabang mula sa AI at HPC sa pangkalahatan. Ito ay partikular na nangingibabaw sa mga pagpapadala ng mga AI GPU, dahil ginagawa nito ang mga ito para sa parehong Nvidia (na kumokontrol sa higit sa 90% ng mga pagpapadala) at AMD (na kumokontrol ng mas mababa sa 10%).

AI at HPC Nagkakaroon ng Kahalagahan para sa TSMC

Ang TSMC mismo ay nagbibigay ng medyo detalyadong hati ng kita na malinaw na nakikilala sa pagitan ng automotive, IoT, smartphone, at high-performance computing, ngunit hindi ito sapat na detalyado upang sabihin ang pagkakaiba sa pagitan ng mga chip para sa AI, HPC, client PC, server, at game console. Para sa TSMC, lahat ng mga processor at SoC na ito ay nabibilang sa segment ng HPC — isang segment na umuunlad.

Ang mga produkto ng HPC ay umabot ng 30% ng kita ng TSMC, o $10.389 bilyon, noong 2019. Sa parehong taon, ang mga smartphone SoC ay umabot ng 49% ng kita ng TSMC, o $16.97 bilyon. Ngunit ang bahagi ng mga produkto ng HPC sa kita ng TSMC ay lumalaki: ang kategorya ay umabot ng 33% noong 2020 ($15 bilyon), 37% noong 2021 ($21 bilyon), at 41% noong 2022 ($31.11 bilyon). Ang trend ay naging kabaligtaran para sa mga smartphone SoC, na nagkakahalaga ng 39% ng mga benta ng TSMC noong 2022 ($29.59 bilyon).

Habang ang AMD at Nvidia ay bumibili ng mga boatload ng datacenter-oriented na silicon mula sa TSMC, ang Apple pa rin ang pinakamalaking customer para sa No. 1 na gumagawa ng mga chip sa mundo — lalo na ngayon na mayroon itong parehong smartphone at PC SoCs (na kabilang sa kategorya ng HPC). Ang Apple lamang ang may pananagutan sa humigit-kumulang 23% ng kabuuang benta ng TSMC noong 2022, ayon sa DigiTimes.

Marami pang Chip na Papasok

Habang bumabawi ang sektor ng semiconductor mula sa pagbagsak nito, ang tumataas na interes para sa generative AI ay nagpapasigla sa merkado. Ang Nvidia ay lubos na nakikinabang mula sa AI surge na ito sa pamamagitan ng TSMC-manufactured A100/A30/A800 at H100/H800 compute GPUs. Katulad nito, pinapalawak ng AMD ang mga order sa TSMC para sa paparating nitong mga produkto ng serye ng Instinct MI300 na papasok sa mass production sa ikalawang kalahati ng 2023 sa N5-class node ng TSMC.

Bilang karagdagan, ang Apple, AMD, at Nvidia ay nakatuon na gamitin ang TSMC’s N3 (3nm-class) at N2 (2nm-class) na mga teknolohiya sa produksyon para sa hinaharap na mga chip, ayon sa ulat ng DigiTimes.